BLOG POSTS

Rivoluzionare l'Industria dell'Aviazione con l'Intelligenza Artificiale

Indice

L’industria dell’aviazione è sempre stata all’avanguardia negli sviluppi tecnologici, spingendo costantemente i limiti dell’innovazione. Nel corso degli anni, abbiamo assistito a progressi notevoli in questo settore. Tuttavia, una tecnologia ha recentemente preso il centro del palcoscenico, promettendo di rivoluzionare l’industria dell’aviazione come mai prima d’ora: l’intelligenza artificiale (AI).

Nel corso degli ultimi tre anni, l’Agenzia dell’Unione Europea per la sicurezza aerea (EASA) ha collaborato con tutti gli attori dell’industria dell’aviazione per raggiungere i loro obiettivi. I loro primi due documenti concettuali sull’AI hanno aperto la strada all’approvazione e all’implementazione di sistemi AI che migliorano la sicurezza per gli utenti finali come piloti e controllori del traffico aereo. Questi concetti vengono già applicati a progetti di certificazione attraverso condizioni speciali.

Tuttavia, ci sono ancora importanti questioni legate all’AI nell’aviazione che richiedono attenzione:

- Instaurare la fiducia del pubblico nei prodotti abilitati dall’AI per l’aviazione.

- Prepararsi per la certificazione e l’approvazione dell’automazione avanzata.

- Integrare considerazioni etiche come trasparenza ed equità nei processi di supervisione.

- Sviluppare ulteriori processi, metodi e standard per sbloccare il potenziale dell’AI nel migliorare la sicurezza del trasporto aereo.

La Roadmap AI dell'EASA: Fondamenta per il Concetto di Affidabilità dell'AI

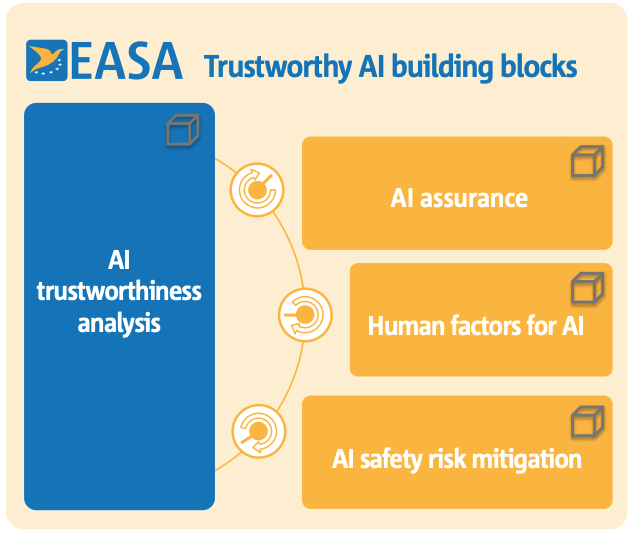

Il concetto di affidabilità dell’AI è un quadro completo progettato per guidare e garantire l’affidabilità, la sicurezza e le considerazioni etiche dei sistemi AI.

Sono identificati quattro pilastri fondamentali per stabilire un quadro di affidabilità dell’AI e abilitare la prontezza all’uso dell’AI nell’aviazione. Tutti e quattro i pilastri costituiscono il nucleo della roadmap AI dell’EASA.

PILASTRO 1: Analisi dell’affidabilità dell’AI

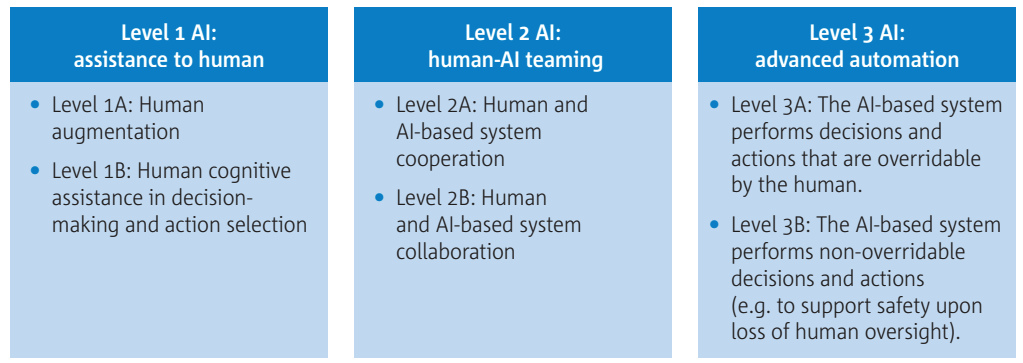

L’analisi dell’affidabilità dell’AI inizia caratterizzando l’applicazione dell’AI e include la valutazione della sicurezza e della sicurezza, che sono componenti cruciali del concetto di analisi dell’affidabilità.Al fine di sottolineare un aspetto significativo dei futuri regolamenti dell’UE sull’AI, l’analisi dell’affidabilità dell’AI affronta il livello di “supervisione umana” nell’applicazione dell’AI, tenendo conto dei tre livelli di applicazioni dell’AI:

PILASTRO 2: Concetto di assicurazione dell’AI

Il pilastro dell’assicurazione dell’AI affronta le linee guida per i sistemi basati sull’AI. Include l’assicurazione dell’apprendimento, che si concentra sul passaggio dalla programmazione all’apprendimento nell’AI/ML, e l’esplicabilità dello sviluppo/post-esercizio, che fornisce informazioni comprensibili su come un’applicazione di AI/ML produce i suoi risultati. Questo pilastro coinvolge anche le capacità di registrazione dei dati per il monitoraggio continuo della sicurezza e l’indagine degli incidenti.PILASTRO 3: Fattori umani per l’AI

Il pilastro dei fattori umani per l’AI fornisce linee guida per affrontare i requisiti specifici dei fattori umani associati all’implementazione dell’AI. Un aspetto importante è l’esplicabilità operativa dell’AI, che coinvolge la fornitura agli utenti finali umani di informazioni comprensibili, affidabili e pertinenti su come un’applicazione di AI/ML produce i suoi risultati, al livello di dettaglio e al momento appropriati. Inoltre, questo pilastro introduce il concetto di collaborazione uomo-IA, che enfatizza la necessità di una cooperazione e collaborazione efficaci tra gli utenti finali umani e i sistemi basati sull’AI per raggiungere gli obiettivi desiderati.PILASTRO 4: Mitigazione dei rischi di sicurezza dell’AI

Il pilastro di mitigazione dei rischi di sicurezza dell’AI riconosce che la completa trasparenza della “scatola nera dell’AI” potrebbe non sempre essere fattibile e riconosce la necessità di affrontare i rischi residui associati all’incertezza intrinseca dell’AI.Innovazioni Abilitate Dall'AI in Droni, U-space e Mobilità Aerea

L’integrazione di successo di aeromobili pilotati e non pilotati, garantendo la condivisione sicura dello spazio aereo e l’implementazione di servizi U-space avanzati, si basa fortemente sull’automazione e su tecnologie rivoluzionarie come l’AI/ML.

L’adozione precoce di soluzioni AI/ML è cruciale per consentire operazioni complesse di droni in ambienti in rapida evoluzione con requisiti rigorosi, come le aree urbane o le regioni con torri di controllo congestionate. Queste soluzioni possono facilitare risposte dinamiche e rapide, come cambiamenti autonomi di traiettoria, in risposta a improvvisi cambiamenti nell’ambiente operativo come incontri o minacce, o la necessità di riconfigurare/limitare dinamicamente lo spazio aereo. Le soluzioni AI/ML svolgono un ruolo fondamentale nell’assicurare l’esecuzione sicura delle operazioni dei droni, anche in situazioni di contingenza o di emergenza. Possono rilevare ostacoli come gru, prevedere le condizioni di formazione di ghiaccio e valutare i rischi a terra, come la presenza del pubblico nei siti di atterraggio previsti.

L’implementazione efficiente dello spazio U, che si occupa di operazioni simultanee di numerosi droni nello stesso volume di spazio aereo, richiede un cambiamento di approccio rispetto ai metodi tradizionali. L’AI/ML emerge come un elemento chiave per soddisfare i requisiti di performance associati alle operazioni dello spazio U.

In particolare, le soluzioni AI/ML fungono da prerequisito tecnico per:

- Sistemi di rilevamento e evitamento (DAA), che sfruttano le capacità dell’AI/ML per analizzare i dati provenienti dai sistemi basati su radar o telecamera.

- Deconfliction adattativa, in cui l’AI/ML predice il rischio di incontri con altri aeromobili lungo un percorso di volo e adatta la traiettoria dei droni in anticipo per garantire una separazione continua.

- Soluzioni di localizzazione/navigazione autonome che operano senza dipendere esclusivamente dal GPS. Le tecniche di AI/ML possono migliorare i sensori di posizionamento, l’aggregazione dei dati e le prestazioni complessive, semplificando e migliorando queste funzioni.

L'AI Nell'Aviazione: Regole, Competenza, Ricerca e Cybersecurity

Sebbene l’integrazione dell’intelligenza artificiale (AI) nell’industria dell’aviazione offra possibilità immense, presenta anche sfide aggiuntive che devono essere affrontate. Oltre al quadro di affidabilità e sicurezza, ci sono diversi ambiti che richiedono attenzione e azione.

Innanzitutto, è fondamentale creare regole e regolamentazioni solide specifiche per l’implementazione dell’AI nell’aviazione. Man mano che i sistemi AI diventano sempre più diffusi, è essenziale stabilire linee guida complete che regolino il loro utilizzo, affrontando aspetti come la formazione, i test e i requisiti operativi. Sviluppando regole chiare e adattabili, l’industria può garantire un approccio standardizzato e sicuro all’integrazione dell’AI.

In secondo luogo, è di primaria importanza potenziare la competenza del personale. Man mano che l’AI diventa parte integrante delle operazioni dell’aviazione, i professionisti devono acquisire le competenze e le conoscenze necessarie per interagire efficacemente con i sistemi AI. Programmi di formazione, workshop e iniziative di educazione continua possono fornire al personale dell’aviazione l’esperienza necessaria per sfruttare il potenziale dell’AI mantenendo al contempo la consapevolezza della situazione e le capacità di prendere decisioni critiche.

Inoltre, gli sforzi di ricerca e sviluppo devono essere intensificati per tenere il passo con il panorama in continua evoluzione dell’AI. La ricerca continua su algoritmi avanzati, tecniche di apprendimento automatico e analisi dei dati è fondamentale per sbloccare nuove possibilità e perfezionare le applicazioni esistenti di AI nell’aviazione. Investendo nella ricerca, l’industria può rimanere all’avanguardia delle innovazioni tecnologiche e massimizzare i benefici dell’AI.

Inoltre, le considerazioni sulla cybersecurity sono di fondamentale importanza in un ecosistema dell’aviazione basato sull’AI. Man mano che i sistemi AI diventano sempre più interconnessi e basati sui dati, è cruciale proteggere le informazioni critiche e garantire misure di cybersecurity robuste. Attraverso l’implementazione di protocolli di cybersecurity robusti e la valutazione regolare delle vulnerabilità, l’industria dell’aviazione può difendersi da potenziali minacce e mantenere l’integrità e la resilienza dei sistemi AI.

In conclusione, mentre l’integrazione dell’AI nell’aviazione offre prospettive entusiasmanti, richiede anche attenzione a una serie di sfide. Affrontando questioni come la creazione di regole, la competenza del personale, la ricerca e lo sviluppo, e la cybersecurity, l’industria può affrontare efficacemente queste sfide e sbloccare il pieno potenziale dell’AI, garantendo sicurezza, efficienza e affidabilità nel trasporto aereo. Collaborando, innovando e adattandosi, l’industria dell’aviazione continuerà ad abbracciare l’AI come una forza trasformativa che modella il futuro del volo.